机器学习模型已成为现代商业应用程序不可或缺的一部分。对机器学习解决方案的需求不断增长,导致工具和平台的数量显着增加。这些工具和平台支持开发人员训练和部署机器学习模型。 Amazon SageMaker 因其易用性、可扩展性和安全性而受到数据科学家和开发人员的欢迎。

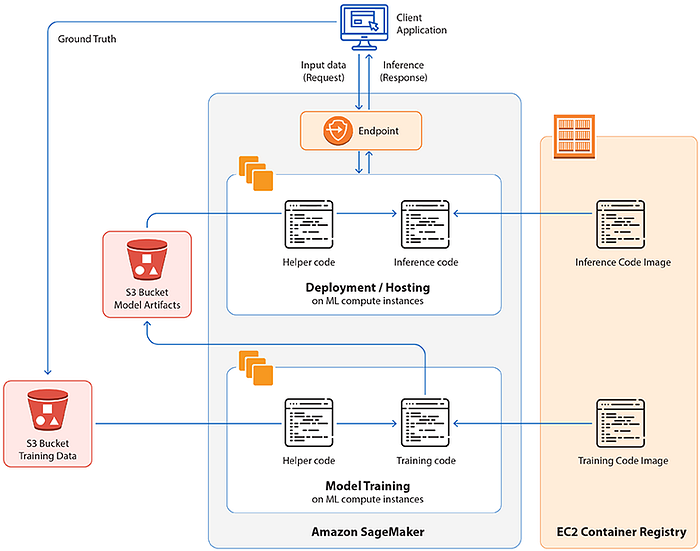

所以,什么是 Amazon SageMaker? Amazon SageMaker 是一个托管机器学习平台。它为数据科学家和开发人员提供了大规模生成、训练和部署机器学习模型所需的基本资源和工具。

可扩展的机器学习模型部署对于处理海量数据的组织至关重要。通过利用 Amazon SageMaker 等基于云的解决方案,企业可以高效且有效地部署和扩展其模型。

SageMaker 允许您通过 TensorFlow、PyTorch 和 Apache MXNet 等流行的机器学习框架构建和训练模型。 SageMaker 还为图像分类和自然语言处理等常见用例提供预构建算法。在这篇博文中,我们将讨论如何使用 Amazon SageMaker 部署机器学习模型。

<块引用>

全球机器学习市场预计将从 2022 年的 211.7 亿美元增长到 2029 年的 2099.1 亿美元,复合年增长率为 38.8%。

-财富商业洞察

使用 Amazon SageMaker 部署机器学习模型涉及哪些步骤?

机器学习已成为当今许多企业的重要组成部分。然而,部署机器学习模型可能是一项具有挑战性的任务,特别是对于扩展和管理模型而言。这就是 Amazon SageMaker 发挥作用的地方。 Amazon SageMaker 通过提供用于构建、训练和部署机器学习模型的集成环境来简化机器学习开发流程。在我们继续执行这些步骤之前,您可能需要阅读 SageMaker 非常适合机器学习的 10 大理由。

<图>

<源data-testid =“og”尺寸=“(最小分辨率:4dppx)和(最大宽度:700px)50vw,(-webkit-min-device-pixel-ratio:4)和(最大宽度:700px) )50vw,(最小分辨率:3dppx)和(最大宽度:700px)67vw,(-webkit-min-device-pixel-ratio:3)和(最大宽度:700px)65vw,(最小分辨率:2.5 dppx)和(最大宽度:700px)80vw,(-webkit-min-device-pixel-ratio:2.5)和(最大宽度:700px)80vw,(最小分辨率:2dppx)和(最大宽度:700px ) 100vw, (-webkit-min-device-pixel-ratio: 2) 和 (最大宽度: 700px) 100vw, 700px" srcset="https://miro.medium.com/v2/resize:fit:640/ 1*wy_zFC3bz-kdHuHTek4oXQ.png 640w,https://miro.medium.com/v2/resize:fit:720/1*wy_zFC3bz-kdHuHTek4oXQ.png 720w,https://miro.medium.com/v2/resize:适合:750/1*wy_zFC3bz-kdHuHTek4oXQ.png 750w,https://miro.medium.com/v2/resize:fit:786/1*wy_zFC3bz-kdHuHTek4oXQ.png 786w,https://miro.medium.com/ v2/resize:fit:828/1*wy_zFC3bz-kdHuHTek4oXQ.png 828w,https://miro.medium.com/v2/resize:fit:1100/1*wy_zFC3bz-kdHuHTek4oXQ.png 1100w,https://miro。 medium.com/v2/resize:fit:1400/1*wy_zFC3bz-kdHuHTek4oXQ.png 1400w"/>

第 1 步:训练和评估您的模型

部署机器学习模型的第一步是训练和评估模型。 Amazon SageMaker 提供了一个 Jupyter Notebook 环境,可以开发和测试您的机器学习算法。您可以使用此环境来创建和运行您的培训和评估代码。训练模型后,您可以将模型工件保存到 Amazon S3。

第 2 步:创建 SageMaker 模型

完成训练和评估机器学习模型后,下一步是创建 SageMaker 模型。 SageMaker 模型是包含 ML 模型的 Docker 容器。指定模型工件在 Amazon S3 中的位置、Docker 容器的名称以及加载模型以生成 SageMaker 模型所需的代码。

第 3 步:创建端点配置

创建 SageMaker 模型后,下一步是创建端点配置。端点配置是一种设置,概述了托管端点所需的实例的数量和类型。您可以使用 Amazon SageMaker 控制台或 Amazon SageMaker API 创建终端节点配置。

第 4 步:部署模型

下一步是部署模型。您可以通过使用上一步中创建的端点配置创建端点来部署模型。 Amazon SageMaker 提供完全托管的基础设施来托管您的终端节点,其中包括自动扩展和负载平衡。

AWS ML 模型部署允许组织利用基于云的解决方案大规模部署机器学习模型。借助 Amazon SageMaker,开发人员可以在 AWS 基础设施上轻松创建、训练和部署模型。

第 5 步:监控和维护端点

您可以使用 Amazon CloudWatch 执行 ML 模型监控。它提供延迟和请求计数等指标。您还可以使用此信息来优化端点性能。许多组织已经部署 Amazon SageMaker 来执行 A/B 测试并比较不同机器学习模型的性能。

监控机器学习模型对于确保它们随着时间的推移继续准确执行至关重要。 Amazon SageMaker 提供内置的 ML 模型监控功能,使开发人员能够在潜在问题造成重大问题之前识别并修复它们。

第 6 步:更新或删除端点

您可以通过创建新的端点配置并部署新模型来更新端点。您还可以使用 Amazon SageMaker 控制台或 Amazon SageMaker API 删除终端节点。

使用 Amazon SageMaker 部署机器学习模型有哪些优势?

使用 Amazon SageMaker 部署机器学习模型具有多项优势。首先,SageMaker 提供用户友好的界面和预构建的算法,使构建、训练和部署模型变得容易。此外,SageMaker可以适应工作负载的变化并处理复杂的模型和大量的数据。此外,您可以通过采用基于使用情况的定价模型来降低基础设施成本。

SageMaker 与其他 AWS 服务无缝集成,增强了其功能。它提供加密和访问控制等安全功能来保护数据和模型。最后,SageMaker 使组织能够使用自己的框架和算法定制机器学习管道。它还提供了许多部署替代方案,使其能够适应不同的应用程序。

我们如何帮助您使用 Amazon SageMaker 部署机器学习模型

Softweb 是领先的技术咨询和开发公司之一,专注于提供创新解决方案,帮助企业利用人工智能和机器学习的力量。我们提供多种服务来支持企业使用 Amazon SageMaker 实施机器学习模型,包括数据探索和准备、模型开发和部署。

Softweb 的机器学习工程师、数据科学家和软件开发人员团队与客户合作,确保他们的模型针对准确性和性能进行优化,并安全高效地部署。我们在使用 Amazon SageMaker 创建和部署机器学习模型方面拥有丰富的经验。我们帮助企业实现人工智能目标并产生显着的业务成果。

最终决定

Amazon SageMaker 提供完全托管的机器学习服务,可简化机器学习模型的部署。在这篇博文中,我们了解了使用 Amazon SageMaker 部署机器学习模型所涉及的步骤。这些步骤包括训练和评估模型、创建 SageMaker 模型、创建端点配置、部署模型、监控和维护端点以及更新或删除端点。

如果您计划使用 SageMaker 部署 ML 模型,建议您向 AWS SageMaker 咨询服务提供商寻求帮助,以确保 ML 模型的部署顺利且无错误。如需了解更多信息,请咨询我们的专家。