在当今快节奏的世界中,我们受到的信息轰炸超出了我们的处理能力。我们越来越习惯在更短的时间内接收更多信息,这导致在必须阅读大量文档或书籍时感到沮丧。这就是提取式摘要的用武之地。为了深入文本的核心,该过程从文章、文章或页面中提取关键句子,让我们快速了解其最重要的要点。

对于任何需要理解大型文档而不需要阅读每个单词的人来说,这是一个游戏规则改变者。

在本文中,我们深入研究了提取摘要的基础知识和应用。我们将研究大型语言模型的作用,特别是 BERT (来自 Transformers 的双向编码器表示),增强了这一过程。本文还将包括有关使用 BERT 进行提取摘要的实践教程,展示其将大量文本压缩为内容丰富的摘要的实用性。

了解提取摘要

提取摘要是自然语言处理 (NLP) 和文本分析领域的一项重要技术。通过它,从原文中精心挑选关键句子或短语,并将其组合起来,形成简洁而内容丰富的摘要。这包括仔细筛选文本,以确定所选文章中最关键的元素和中心思想或论点。

抽象摘要涉及生成源材料中通常不存在的全新句子,而提取摘要则坚持原始文本。它不会改变或释义,而是准确地提取句子,保持原来的措辞和结构。这样,摘要就可以忠实于源材料的语气和内容。在优先考虑信息准确性和保留作者原意的情况下,提取摘要技术非常有用。

它有许多不同的用途,例如总结新闻文章、学术论文或冗长的报告。该过程有效地传达了原始内容的信息,而不会出现释义时可能出现的潜在偏见或重新解释。

提取摘要如何使用法学硕士?

1。文本解析

这个初始步骤涉及将文本分解为其基本元素,主要是句子和短语。目标是识别算法稍后将评估的基本单元(在本上下文中为句子),以包含在摘要中,例如剖析文本以了解其结构和各个组成部分。

例如,模型会通过将四句段落分解为以下四句组成部分来分析该段落。

- 吉萨金字塔建于古埃及,宏伟地矗立了数千年。

- 它们是为法老建造的坟墓。

- 大金字塔是最著名的。

- 这些结构象征着建筑智慧。

2。特征提取

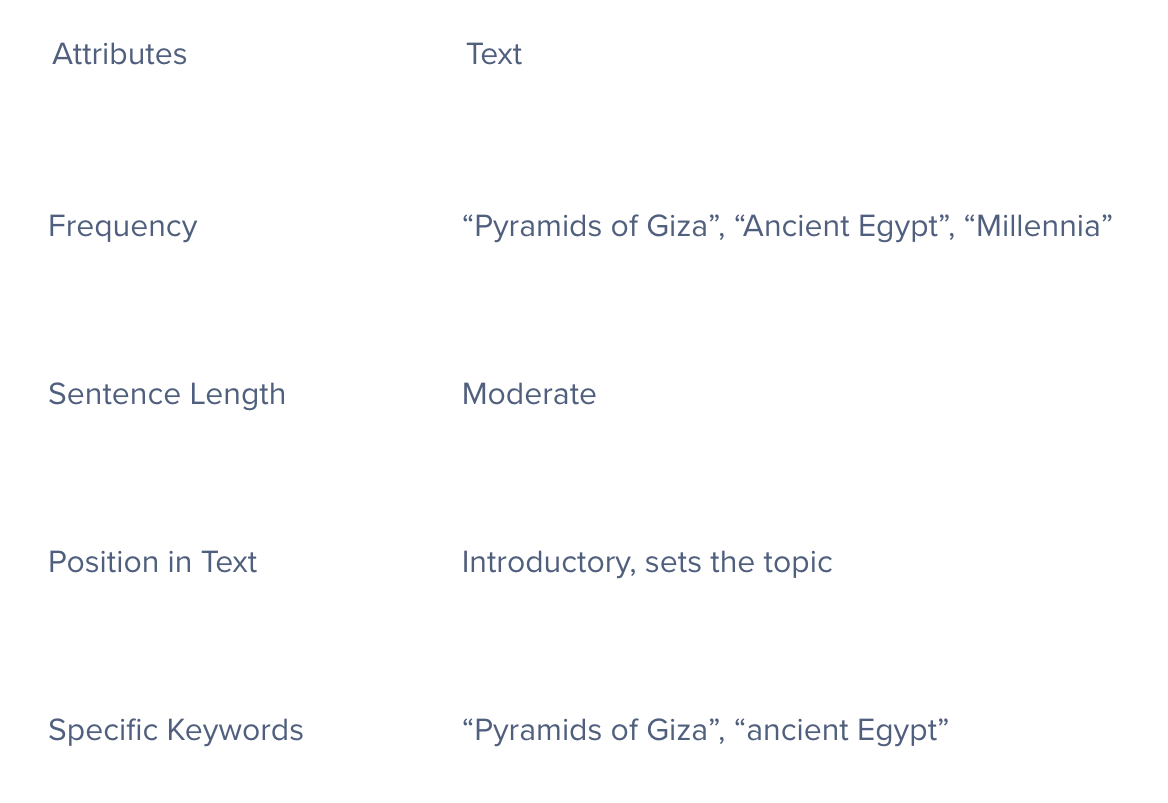

在此阶段,算法会分析每个句子,以识别可能表明它们对整个文本的重要性的特征或“特征”。常见特征包括关键字和短语的频率和重复使用、句子的长度、它们在文本中的位置及其含义,以及作为文本主题核心的特定关键字或短语的存在。

下面是法学硕士如何对第一句话进行特征提取的示例:“吉萨金字塔,建于古埃及,矗立千年。”

3。给句子评分

每个句子都会根据其内容分配一个分数。该分数反映了句子在整个文本上下文中的重要性。得分较高的句子被认为具有更大的分量或相关性。

简单地说,这个过程会评估每个句子对整个文本摘要的潜在重要性。

4。选择和聚合

最后阶段涉及选择得分最高的句子并将其编译成摘要。如果仔细完成,这可以确保摘要保持连贯,并总体代表原文的主要思想和主题。

为了创建有效的摘要,算法必须平衡包含简洁的重要句子、避免冗余的需求,并确保所选句子能够清晰、全面地概述整个原始文本。

- 吉萨金字塔建于古埃及,雄伟地矗立了数千年。它们是为法老建造的坟墓。这些结构象征着建筑的辉煌。

这个例子非常基础,从总共 4 个句子中提取 3 个来获得最佳的整体总结。多读一个句子并没有什么坏处,但是当文本更长时会发生什么呢?比方说,3 段?

如何使用 BERT LLM 运行提取摘要

第 1 步:安装并导入必要的软件包

我们将利用预训练的 BERT 模型。然而,我们不会只使用任何 BERT 模型;相反,我们将重点关注 BERT Extractive Summarizer。这个特定的模型已经针对提取摘要中的专门任务进行了微调。

!pip install bert-extractive-summarizer 从摘要器导入摘要器

步骤 2

从Python中的summarizer导入的Summarizer()函数是一个提取文本摘要工具。它使用BERT模型从较大的文本中分析和提取关键句子。此功能旨在保留最重要的信息,提供原始内容的浓缩版本。它通常用于有效地总结冗长的文档。

模型 = Summarizer()

第 3 步:导入文本

在这里,我们将导入我们想要测试模型的任何文本。为了测试我们的提取摘要模型,我们使用 ChatGPT 3.5 生成文本,并提示:“提供 GPU 历史及其当今使用方式的 3 段摘要。”

text = “图形处理单元 (GPU) 的历史可以追溯到 20 世纪 80 年代初,当时 IBM 和德州仪器 (Texas Instruments) 等公司开发了专门的图形加速器,用于渲染图像和提高整体图形性能。然而,直到 1990 年代末才出现2000 年代初,随着 3D 游戏和多媒体应用的出现,GPU 得到了重视。1999 年发布的 NVIDIA GeForce 256 通常被认为是第一款 GPU,因为它在单个芯片上集成了 2D 和 3D 加速。ATI(后来被 ATI 收购) AMD)在这一时期的 GPU 发展中也发挥了重要作用。GPU 的并行架构拥有数千个核心,允许它们同时处理多个计算,非常适合需要大规模并行性的任务。今天,GPU已经远远超出了最初以图形为中心的目的,现在广泛用于各个领域的并行处理任务,例如科学模拟、人工智能和机器学习。金融、医疗保健和汽车工程等行业利用 GPU 进行复杂的数据分析、医学成像和自动驾驶汽车开发,展示了其超越传统图形应用程序的多功能性。随着技术的进步,现代 GPU 不断突破计算能力的界限,通过并行计算在各个领域实现突破。 GPU 仍然是游戏行业不可或缺的一部分,为视频游戏提供身临其境且逼真的图形,其中高性能 GPU 增强视觉体验并支持要求苛刻的游戏图形。随着技术的进步,GPU 有望在塑造计算的未来方面发挥更加关键的作用。”

这是代码块内没有它的文本:

“图形处理单元 (GPU) 的历史可以追溯到 20 世纪 80 年代初,当时 IBM 和德州仪器 (Texas Instruments) 等公司开发了专门的图形加速器,用于渲染图像和提高整体图形性能。但是,直到 90 年代末和初2000 年代,随着 3D 游戏和多媒体应用的出现,GPU 得到了重视。1999 年发布的 NVIDIA GeForce 256 通常被认为是第一款 GPU,因为它在单个芯片上集成了 2D 和 3D 加速。ATI(后来被 AMD 收购)在此期间 GPU 的发展也发挥了重要作用。

GPU 的并行架构拥有数千个核心,允许它们同时处理多个计算,从而非常适合需要大规模并行性的任务。如今,GPU 的发展已经远远超出了其最初以图形为中心的用途,现在广泛用于各个领域的并行处理任务,例如科学模拟、人工智能和机器学习。金融、医疗保健和汽车工程等行业利用 GPU 进行复杂的数据分析、医学成像和自动驾驶汽车开发,展示了其超越传统图形应用程序的多功能性。

随着技术的进步,现代 GPU 不断突破计算能力的界限,通过并行计算在各个领域实现突破。 GPU 仍然是游戏行业不可或缺的一部分,为视频游戏提供身临其境且逼真的图形,其中高性能 GPU 增强视觉体验并支持要求苛刻的游戏图形。随着技术的进步,GPU 有望在塑造计算的未来方面发挥更加关键的作用。”

第 4 步:执行提取摘要

最后,我们将执行我们的摘要函数。该函数需要两个输入:要摘要的文本和摘要所需的句子数。处理后,它将生成一个提取摘要,然后我们将显示该摘要。

# 指定摘要中的句子数量 摘要 = 模型(文本,num_sentences=4) 打印(摘要)

提取摘要输出

图形处理单元 (GPU) 的历史可以追溯到 20 世纪 80 年代初,当时 IBM 和 Texas Instruments 等公司开发了专门的图形加速器,用于渲染图像和提高整体图形性能。 NVIDIA 于 1999 年发布的 GeForce 256 通常被认为是第一款 GPU,因为它在单个芯片上集成了 2D 和 3D 加速功能。如今,GPU 的发展已经远远超出了其最初以图形为中心的用途,现在广泛用于各个领域的并行处理任务,例如科学模拟、人工智能和机器学习。随着技术的进步,GPU 有望在塑造计算的未来方面发挥更加关键的作用。

我们的模型从我们的大型文本语料库中提取了 4 个最重要的句子来生成此摘要!

使用法学硕士进行提取总结的挑战

上下文理解限制

虽然法学硕士精通处理和生成语言,但他们对上下文的理解,尤其是较长文本的理解是有限的。法学硕士可能会错过微妙的细微差别或无法识别文本的关键方面,从而导致摘要不太准确或相关。语言模型越高级,总结就越好。

训练数据的偏差

法学硕士可以从各种来源(包括互联网)汇编的大量数据集中学习。这些数据集可能包含偏差,模型可能会无意中学习并在摘要中复制这些偏差,从而导致偏差或不公平的表示。

处理专业或技术语言

虽然法学硕士通常接受过广泛的通用文本培训,但他们可能无法准确捕捉法律、医学或其他高科技领域等领域的专业或技术语言。通过提供更专业和技术性的文本可以缓解这种情况。缺乏专业术语培训可能会影响在这些领域使用摘要的质量。

结论

很明显,提取摘要不仅仅是一个方便的工具;它还是一个工具。在我们这个信息饱和的时代,我们每天都被文字墙淹没,这变得越来越必要。通过利用 BERT 等技术的力量,我们可以看到如何将复杂的文本提炼成易于理解的摘要,从而节省我们的时间并帮助我们进一步理解正在总结的文本。

无论是学术研究、商业洞察,还是只是在技术先进的世界中保持信息灵通,提取式总结都是在我们周围的信息海洋中导航的实用方法。随着自然语言处理的不断发展,提取摘要等工具将变得更加重要,帮助我们快速查找和理解在分秒必争的世界中最重要的信息。